Redes Sociales y Ciberacoso 2.0: Nuevas Formas de Agresión Digital Difíciles de Reconocer

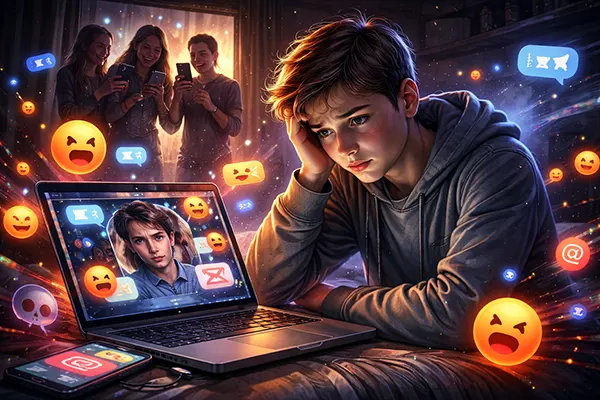

Para 2026, el ciberacoso ha evolucionado mucho más allá de los insultos directos y el hostigamiento evidente. Ahora opera mediante clips editados, contenido sintético, denuncias coordinadas y manipulación reputacional que a menudo parecen inofensivos a primera vista. Las redes sociales se han convertido en entornos donde la humillación puede ser diseñada, amplificada y disfrazada de humor, comentario o “drama”. La dificultad no reside solo en la agresión en sí, sino en lo convincentemente que imita la interacción digital normal.

Cómo es el Ciberacoso 2.0 en 2026

Uno de los desarrollos más preocupantes es el uso de contenido generado por inteligencia artificial. Las imágenes y vídeos deepfake pueden producirse ahora con herramientas de uso general, lo que permite fabricar material comprometedor sin necesidad de acceder a archivos privados. En los últimos años, centros educativos de Europa y Norteamérica han informado de casos en los que estudiantes utilizaron imágenes sintéticas para atacar a compañeros, convirtiendo disputas personales en humillaciones públicas en cuestión de horas.

Otro patrón creciente es el acoso digital coordinado. Una sola publicación puede desencadenar comentarios masivos, etiquetas y republicaciones diseñadas para abrumar a la persona afectada. A diferencia del acoso tradicional, los agresores pueden no utilizar amenazas explícitas; en su lugar, recurren al ridículo, comentarios sarcásticos o clips editados que presentan sutilmente al individuo como objeto de entretenimiento.

También son frecuentes las tácticas de exposición parcial. Esto incluye compartir fragmentos de conversaciones privadas, pistas sobre el lugar de trabajo o detalles de ubicación que no llegan a ser una divulgación completa de datos personales, pero que generan miedo y daño reputacional. Estas acciones suelen escalar gradualmente, lo que dificulta clasificarlas como abuso grave hasta que el perjuicio ya está hecho.

Por Qué Estas Formas Son Difíciles de Detectar al Principio

La agresión digital moderna suele esconderse tras la ambigüedad. El contenido se presenta como sátira, rendición de cuentas o simple cotilleo. Al no haber un insulto directo, los observadores dudan en intervenir y las víctimas pueden cuestionar si están exagerando.

Los algoritmos de recomendación intensifican el impacto. Cuando el contenido hostil genera interacción, es más probable que se muestre repetidamente, se comparta o se recomiende. Esta repetición amplifica el estrés psicológico, incluso si la publicación original parecía menor.

Gran parte de la presión también ocurre en espacios semiprivados como chats grupales o comunidades cerradas. La cronología pública puede parecer tranquila mientras la coordinación del acoso sucede en otros lugares. Esta fragmentación dificulta enormemente la recopilación de pruebas y la detección temprana.

IA, Suplantación de Identidad y Acoso Indirecto

Las herramientas basadas en inteligencia artificial han ampliado el repertorio de los agresores digitales. La clonación de voz puede fabricar mensajes de audio convincentes, mientras que los generadores de imágenes pueden situar a una persona en escenarios falsos. Estas tácticas trasladan el acoso de los ataques verbales a la manipulación de identidad.

La suplantación de identidad también se ha vuelto más sofisticada. En lugar de cuentas paródicas evidentes, los agresores crean perfiles realistas con historiales de publicación creíbles. Se editan capturas de pantalla para simular conversaciones y se construyen narrativas falsas destinadas a dañar la credibilidad en entornos profesionales o académicos.

Otro método moderno es el acoso por intermediación. El instigador puede publicar información selectiva que anime a otros a confrontar, criticar o denunciar a la víctima. Así se genera la impresión de que múltiples usuarios actúan de manera independiente, cuando en realidad la agresión ha sido orquestada.

Señales de Advertencia que Suelen Pasar Desapercibidas

La manipulación de contexto es un indicador clave. Cuando solo se publican fragmentos de una conversación o faltan marcas de tiempo, el contenido puede estar intencionadamente encuadrado para inducir a error. Siempre conviene cuestionar pruebas incompletas en discusiones emocionalmente intensas.

La repetición de frases idénticas en múltiples comentarios puede indicar coordinación. Si numerosas cuentas repiten las mismas acusaciones de forma simultánea, rara vez se trata de algo espontáneo.

Las oleadas repentinas de denuncias o restricciones de cuentas son otra señal de alerta. Los sistemas automatizados de moderación pueden ser explotados mediante denuncias masivas, silenciando a una persona sin demostrar una infracción real.

Estrategias de Protección y Respuesta Responsable

La protección eficaz comienza con la documentación adecuada. Las capturas de pantalla deben incluir marcas de tiempo, contexto completo de la conversación y nombres de usuario. Guardar enlaces en lugar de imágenes recortadas refuerza la credibilidad de una reclamación.

Al denunciar un abuso, la precisión es fundamental. Describir el comportamiento —como suplantación de identidad, uso de imágenes sintéticas o acoso coordinado— ayuda a los revisores a evaluar la situación con mayor exactitud. En 2026, muchas jurisdicciones, incluido el Reino Unido bajo la Online Safety Act y los Estados miembros de la UE bajo el marco de la Digital Services Act, exigen mayores estándares de gestión de riesgos y transparencia en los procesos de denuncia.

Igualmente importante es el apoyo psicológico. El ciberacoso 2.0 está diseñado para abrumar y aislar. Fomentar la comunicación abierta con adultos de confianza, colegas o asesores profesionales puede reducir el impacto a largo plazo.

Orientación para Padres, Educadores y Empleadores

Para padres y docentes, los incidentes relacionados con medios sintéticos deben tratarse como cuestiones de protección y seguridad. Las instituciones educativas están actualizando sus políticas de conducta digital para abordar específicamente el abuso generado por IA.

Las escuelas y organizaciones se benefician de procedimientos de investigación estructurados. Verificar el contexto completo antes de aplicar medidas disciplinarias evita una revictimización basada en pruebas manipuladas.

La preparación es esencial. Establecer rutas claras de denuncia, comprender las opciones legales locales y saber cómo asegurar cuentas digitales con antelación proporciona resiliencia. El ciberacoso en 2026 es menos visible, pero no menos dañino, y la concienciación sigue siendo la herramienta preventiva más eficaz.