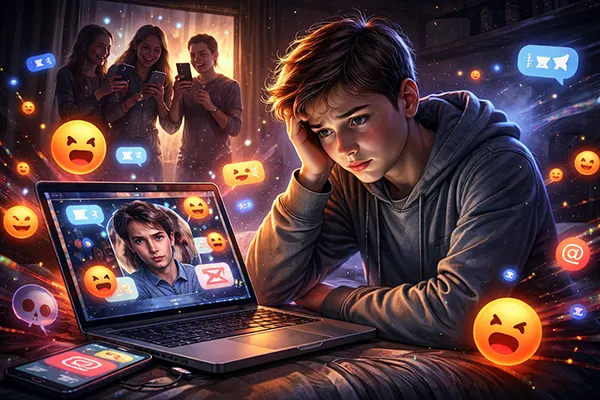

Soziale Netzwerke und Cybermobbing 2.0: Neue Formen digitaler Aggression, die schwer zu erkennen sind

Bis 2026 hat sich Cybermobbing weit über direkte Beleidigungen und offensichtliche Belästigungen hinaus entwickelt. Es funktioniert nun durch bearbeitete Clips, synthetische Medien, koordinierte Meldungen und gezielte Rufschädigung, die auf den ersten Blick harmlos erscheinen. Soziale Netzwerke sind zu Umgebungen geworden, in denen Demütigung geplant, verstärkt und als Humor, Kommentar oder „Drama“ getarnt werden kann. Die Schwierigkeit liegt nicht nur in der Aggression selbst, sondern darin, wie überzeugend sie wie normale Online-Interaktion wirkt.

Wie Cybermobbing 2.0 im Jahr 2026 aussieht

Eine der besorgniserregendsten Entwicklungen ist der Einsatz KI-generierter Inhalte. Deepfake-Bilder und -Videos lassen sich inzwischen mit allgemein zugänglichen Tools erstellen, sodass kompromittierendes Material ohne Zugriff auf private Dateien produziert werden kann. In den vergangenen Jahren wurden in Schulen in Europa und Nordamerika Fälle gemeldet, in denen synthetische Bilder genutzt wurden, um Mitschüler gezielt bloßzustellen.

Ein weiteres wachsendes Muster ist das koordinierte digitale „Dogpiling“. Ein einzelner Beitrag kann Massenkommentare, Markierungen und Weiterverbreitungen auslösen, die darauf abzielen, die betroffene Person zu überfordern. Dabei werden häufig keine direkten Drohungen ausgesprochen, sondern Spott, sarkastische Bemerkungen oder bearbeitete Reaktionsclips genutzt, um jemanden als Objekt der Unterhaltung darzustellen.

Teilweise Offenlegung ist ebenfalls verbreitet. Dazu gehört das Veröffentlichen von Fragmenten privater Gespräche, Hinweisen auf den Arbeitsplatz oder Standortdetails, die unterhalb der Schwelle des vollständigen Doxxings bleiben, jedoch Angst und Reputationsschäden verursachen. Diese Handlungen eskalieren oft schrittweise und sind daher schwer frühzeitig einzuordnen.

Warum diese Formen früh schwer zu erkennen sind

Moderne digitale Aggression basiert häufig auf Mehrdeutigkeit. Inhalte werden als Satire, Rechenschaft oder harmloser Klatsch präsentiert. Da keine offensichtliche Beleidigung vorliegt, zögern Außenstehende einzugreifen, während Betroffene an ihrer eigenen Wahrnehmung zweifeln.

Algorithmisch gesteuerte Feeds verstärken die Wirkung zusätzlich. Inhalte mit hoher Interaktion werden häufiger angezeigt, geteilt oder empfohlen. Diese Wiederholung erhöht den psychologischen Druck erheblich, selbst wenn der ursprüngliche Beitrag scheinbar unbedeutend war.

Ein großer Teil des Drucks entsteht zudem in halbprivaten Räumen wie Gruppenchats oder geschlossenen Communities. Die öffentliche Timeline wirkt ruhig, während im Hintergrund koordinierte Angriffe vorbereitet werden. Diese Fragmentierung erschwert Beweissicherung und frühzeitige Reaktion.

KI, Identitätsmissbrauch und indirekte Belästigung

Künstliche Intelligenz hat die Möglichkeiten digitaler Angreifer erheblich erweitert. Stimmklonen kann überzeugende Audioaufnahmen erzeugen, während Bildgeneratoren Personen in falsche Szenarien versetzen. Cybermobbing verlagert sich dadurch von verbalen Angriffen hin zur Manipulation von Identität.

Auch Identitätsmissbrauch ist professioneller geworden. Anstelle offensichtlicher Parodie-Profile werden realistisch wirkende Accounts mit aufgebauter Historie erstellt. Screenshots werden manipuliert, um gefälschte Gespräche darzustellen und gezielte Narrative zu erzeugen, die berufliche oder akademische Konsequenzen nach sich ziehen können.

Eine weitere Methode ist Belästigung durch Dritte. Einzelne Personen veröffentlichen selektive Informationen, um andere dazu zu bewegen, Kritik zu äußern oder Meldungen einzureichen. Nach außen wirkt dies wie spontane Empörung, tatsächlich handelt es sich jedoch um koordinierte Einflussnahme.

Warnsignale, die häufig übersehen werden

Kontextmanipulation ist ein zentrales Warnzeichen. Werden nur Gesprächsausschnitte ohne Zeitstempel oder vollständigen Verlauf veröffentlicht, besteht ein hohes Risiko bewusster Verzerrung.

Wiederholte identische Formulierungen in mehreren Kommentaren können auf koordinierte Aktionen hinweisen. Gleichlautende Vorwürfe aus unterschiedlichen Accounts entstehen selten zufällig.

Plötzliche Wellen von Meldungen oder Kontoeinschränkungen sind ein weiteres Indiz. Automatisierte Moderationssysteme können durch Massenmeldungen missbraucht werden, wodurch Betroffene vorübergehend zum Schweigen gebracht werden.

Schutzstrategien und verantwortungsbewusstes Handeln

Wirksamer Schutz beginnt mit sorgfältiger Dokumentation. Screenshots sollten Zeitstempel, vollständigen Gesprächskontext und Benutzernamen enthalten. Das Speichern direkter Links erhöht die Nachvollziehbarkeit einer Beschwerde.

Bei Meldungen ist Präzision entscheidend. Die genaue Beschreibung der Handlung – etwa Identitätsmissbrauch, synthetische Bildinhalte oder koordinierte Belästigung – erleichtert eine sachliche Prüfung. Seit 2026 gelten in Großbritannien durch den Online Safety Act sowie in der EU im Rahmen des Digital Services Act strengere Anforderungen an Risikomanagement und Transparenz.

Ebenso wichtig ist psychologische Unterstützung. Cybermobbing 2.0 zielt auf Überforderung und Isolation ab. Offene Gespräche mit Vertrauenspersonen oder professionelle Beratung können langfristige Schäden reduzieren.

Hinweise für Eltern, Lehrkräfte und Arbeitgeber

Für Eltern und Schulen sollten Vorfälle mit synthetischen Medien als ernsthafte Schutzangelegenheiten behandelt werden. Bildungseinrichtungen aktualisieren zunehmend ihre Richtlinien, um KI-generierte Übergriffe explizit zu berücksichtigen.

Schulen und Unternehmen profitieren von klar definierten Prüfverfahren. Eine sorgfältige Kontextüberprüfung vor disziplinarischen Maßnahmen verhindert zusätzliche Viktimisierung durch manipulierte Inhalte.

Vorbereitung ist entscheidend. Klare Meldewege, Kenntnisse rechtlicher Optionen und Strategien zur Kontosicherung stärken die Widerstandsfähigkeit. Cybermobbing im Jahr 2026 ist weniger sichtbar, aber nicht weniger schädlich.